.jpg)

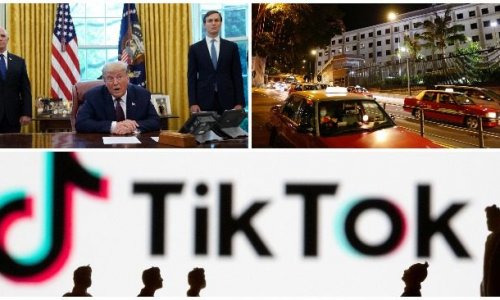

Điều tra cho thấy, TikTok đề xuất video về tình dục và ma túy cho người dùng trẻ vị thành niên. (JOHN MACDOUGALL/AFP qua Getty Images)

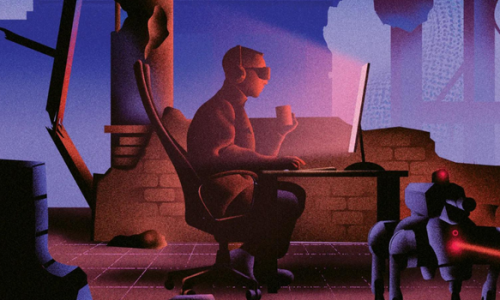

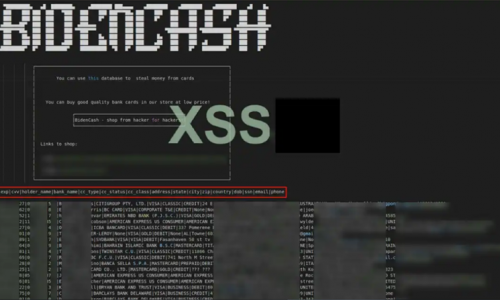

Một cuộc điều tra của The Wall Street Journal cho thấy, TikTok, một ứng dụng phổ biến trên toàn thế giới, sử dụng các thuật toán để đẩy nội dung liên quan đến các trang web về ma túy và tình dục tới người dùng vị thành niên, khiến họ nhanh chóng rơi vào hố đen video người lớn.

Để nắm được TikTok đang đẩy những nội dung gì cho người dùng thanh niên, The Wall Street Journal (WSJ) đã đăng ký hàng chục tài khoản tự động và chọn lứa tuổi là từ 13 đến 15 tuổi. Các tài khoản robot trên có thể tùy ý xem duyệt các luồng video trong mục “For You” (Dành Cho Bạn) của nền tảng này. Những video này được cá nhân hóa mức độ cao và được tạo bởi các thuật toán, nội dung có thể nói là vô cùng vô tận.

Sau khi phân tích các video được đề xuất cho các tài khoản tự động nói trên, WSJ nhận thấy rằng thông qua các thuật toán mạnh mẽ, TikTok có thể nhanh chóng đưa trẻ vị thành niên rơi vào hố sâu không đáy chứa đầy nội dung liên quan đến tình dục và ma túy.

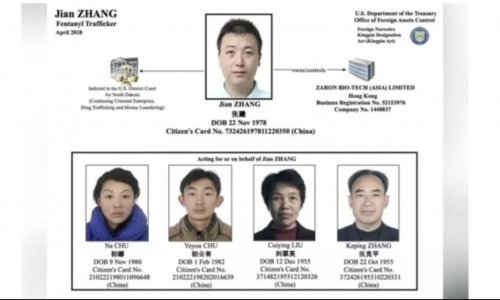

Ví dụ: TikTok đã đề xuất ít nhất 569 video liên quan đến việc sử dụng ma túy cho một tài khoản được đăng ký là thiếu niên 13 tuổi, nội dung video liên quan đến chứng nghiện cocaine và methamphetamine, cũng như video quảng cáo bán ma túy và đồ dùng trực tuyến. Các tài khoản vị thành niên khác mà WSJ đăng ký để điều tra cũng đã nhận được hàng trăm hàng nghìn video tương tự.

Ngay cả khi tài khoản đó được cài đặt là quan tâm đến nhiều chủ đề khác nhau, TikTok đôi khi vẫn tập trung vào một chủ đề duy nhất và liên tiếp đẩy hàng trăm video liên quan đến cùng một chủ đề.

Ví dụ: Một tài khoản của WSJ được thiết lập quan tâm đến nhiều danh mục, TikTok đã đề xuất hàng trăm bộ phim hoạt hình Nhật Bản, trong đó có nhiều chủ đề liên quan đến tình dục.

TikTok cũng hiển thị hơn một trăm video quảng cáo từ các trang web khiêu dâm trả phí và cửa hàng bán đồ dùng tình dục cho các tài khoản vị thành niên của WSJ, cũng như hàng nghìn nội dung được đánh dấu là "chỉ dành cho người lớn".

Có trường hợp, người tạo sản phẩm trên TikTok nói rõ rằng họ không muốn trẻ em xem video của mình và đánh dấu những video này là chỉ dành cho người lớn. Nhưng TikTok vẫn đề xuất những video này.

Tổng cộng, ít nhất 2.800 video được đánh dấu là video chỉ dành cho người lớn đã được đề xuất cho các tài khoản trẻ vị thành niên của WSJ.

WSJ đã gửi cho TikTok 974 mẫu video do nền tảng này cung cấp cho các tài khoản trẻ vị thành niên mà WSJ tự lập để điều tra. Chúng liên quan đến ma túy, tình dục và các nội dung người lớn khác, trong đó có hàng trăm video được hiển thị liên tiếp cho đúng một tài khoản.

Người phát ngôn của TikTok cho biết, nền tảng này đã xóa một số video mà tài khoản của WSJ đã xem và hạn chế các video khác, nhưng không tiết lộ con số cụ thể. Người phát ngôn cũng tuyên bố rằng, về mặt kiểm soát nội dung, không có thuật toán nào là chính xác mà không có sai sót.

Ông Marc Berkman, Giám đốc điều hành của Social Media Safety, cho biết phản ứng của TokTok không đủ tốt. Social Media Safety là một tổ chức bảo vệ người tiêu dùng nổi tiếng ở Mỹ, đã dạy các kỹ năng an toàn trên mạng xã hội cho hàng nghìn học sinh, phụ huynh và các nhà giáo dục, cũng như phát triển luật để ngăn chặn bạo lực do mạng xã hội gây ra.

“TikTok và các nền tảng khác có thể làm rất nhiều điều để đảm bảo rằng, đặc biệt là người dùng trẻ em sẽ không nhìn thấy nội dung nguy hiểm này”, ông Berkman nói, “Đầu tiên, TikTok có thể mở dữ liệu của họ cho phần mềm bảo mật bên thứ ba, như vậy ít nhất cha mẹ có thể lựa chọn giám sát những nội dung này...".

Ông nói rằng TikTok "vốn dĩ có thể thực hiện việc can thiệp này, nó rất quan trọng nhưng nó đã không được thực hiện".

Một cuộc khảo sát video trước đó được thực hiện bởi WSJ cho thấy, TikTok chỉ cần sử dụng một thông tin quan trọng là có thể phân tích sở thích của người dùng, đó là: khoảng thời gian người dùng xem một nội dung cụ thể.

Ông Guillaume Chaslot, một cựu kỹ sư của YouTube, nói với WSJ: "Tất cả những gì chúng ta thấy trên YouTube đều bắt nguồn từ các thuật toán về mức độ tương tác của người dùng. TikTok cũng hoàn toàn như vậy, nhưng tình hình còn tệ hơn". Ông Chaslot trước đây từng làm việc liên quan đến các thuật toán ở YouTube.

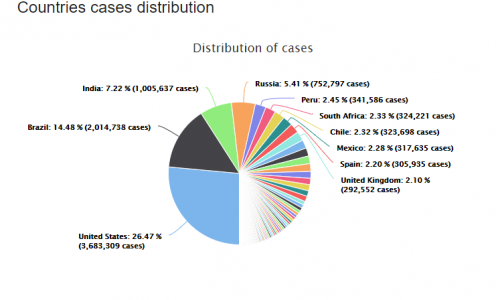

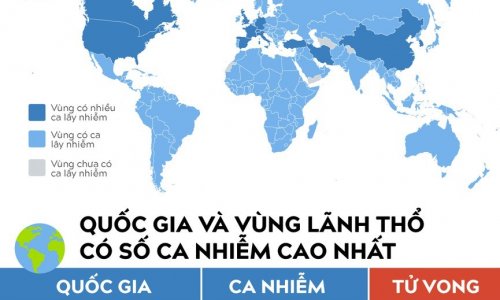

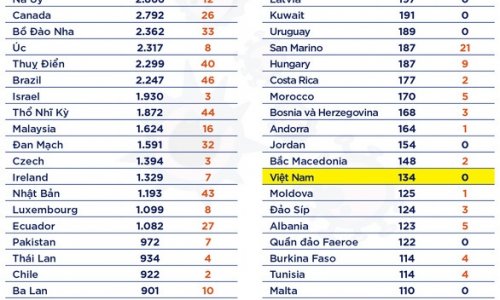

Trong số khoảng 100 triệu người dùng hoạt động hàng tháng của TikTok, thanh thiếu niên là nhóm lớn nhất. Theo dữ liệu của công ty này, năm ngoái (2020), trẻ vị thành niên chiếm hơn 1/4 số người dùng ứng dụng.

Vào tháng 7, một cuộc khảo sát của Business Insider cho thấy thuật toán của TikTok tự động đề xuất nội dung xoay quanh chứng rối loạn ăn uống, điều này dường như vi phạm nguyên tắc cộng đồng của TikTok. Tài khoản robot của WSJ phát hiện ra rằng nền tảng này có một số nội dung khuyến khích việc ăn uống bất thường và lái xe khi say rượu.

(ntdvn.com - Theo Epoch Times tiếng Trung)