Ảnh: Adobe Stock

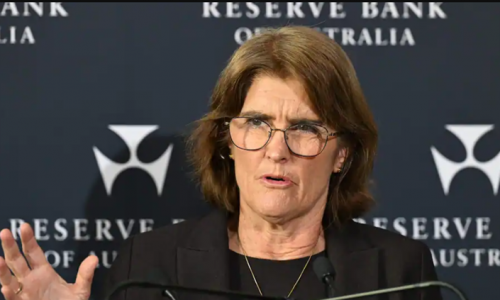

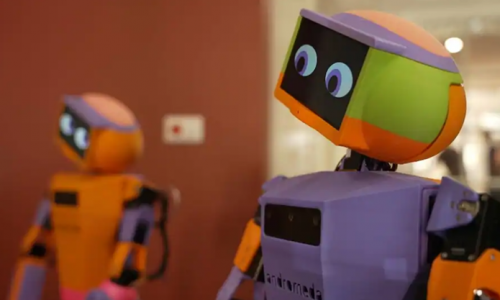

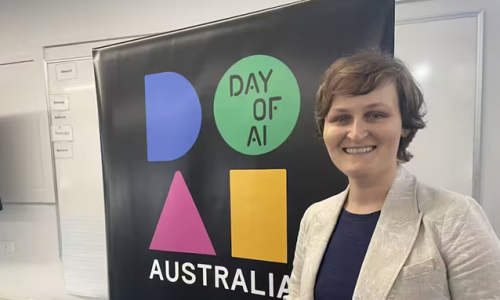

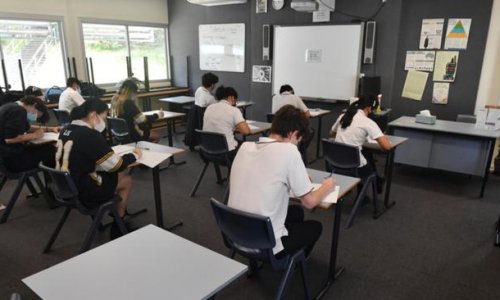

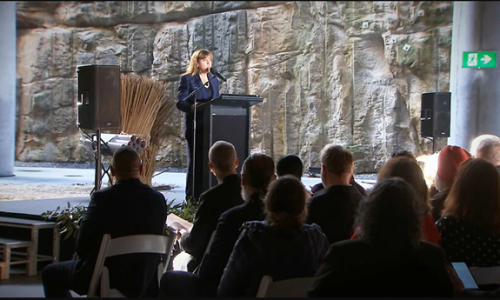

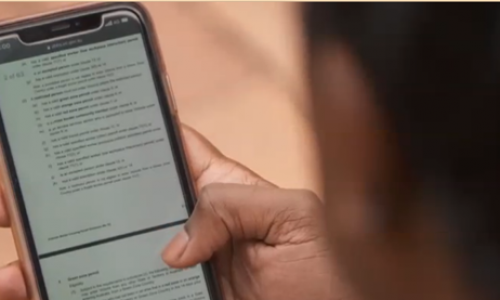

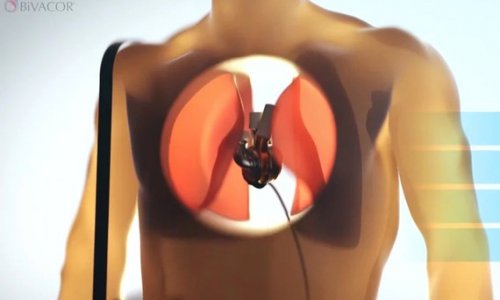

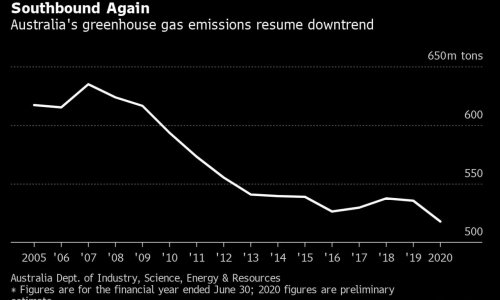

AUSTRALIA - Động thái trên được cơ quan hữu trách Úc đưa ra trong bối cảnh các công cụ AI đang ngày càng được sử dụng rộng rãi trong cộng đồng doanh nghiệp và đời sống hàng ngày.

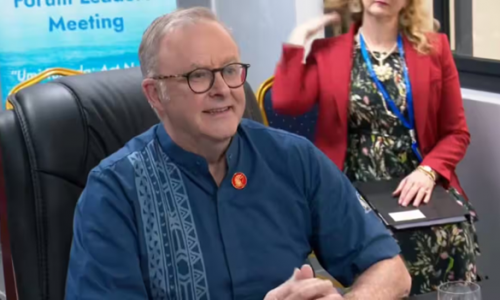

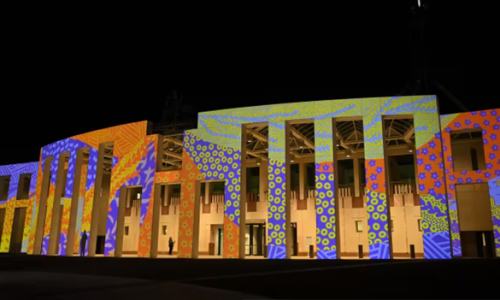

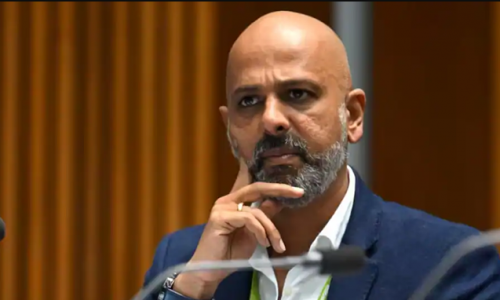

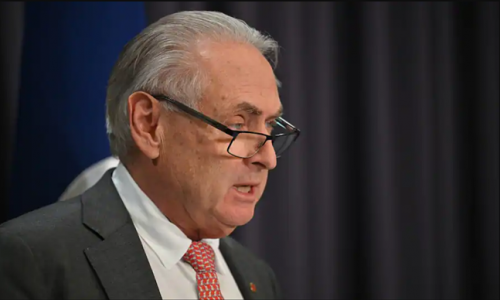

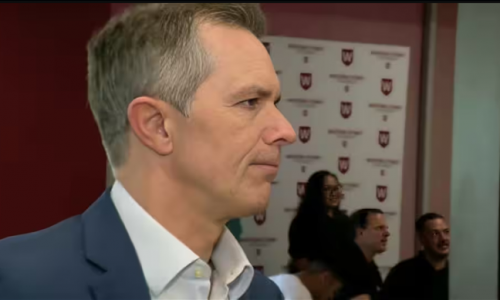

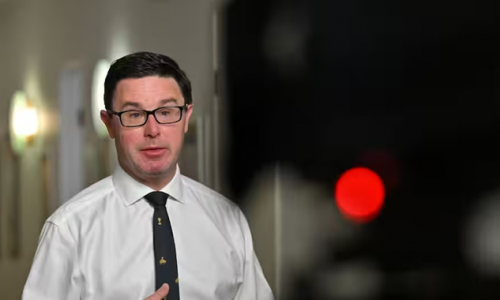

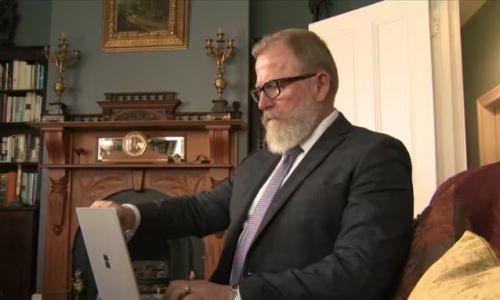

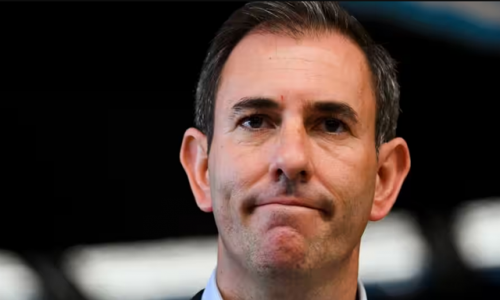

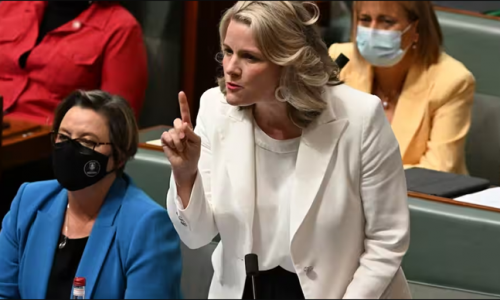

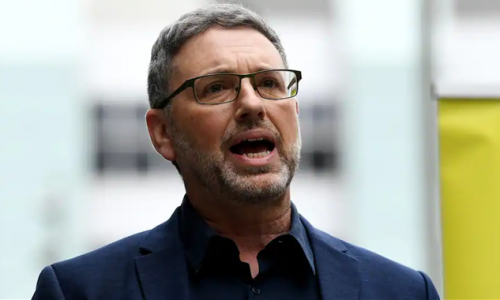

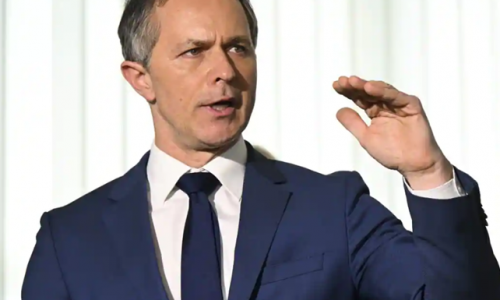

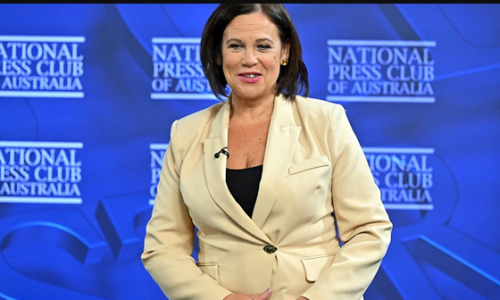

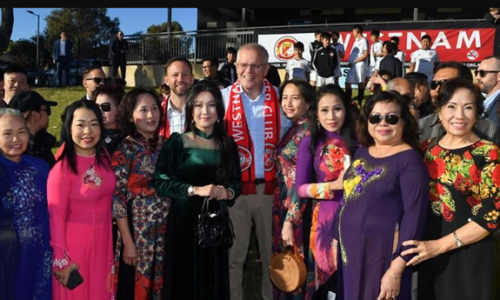

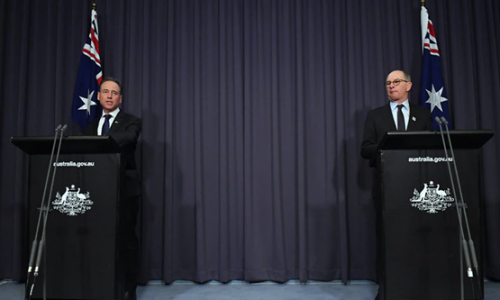

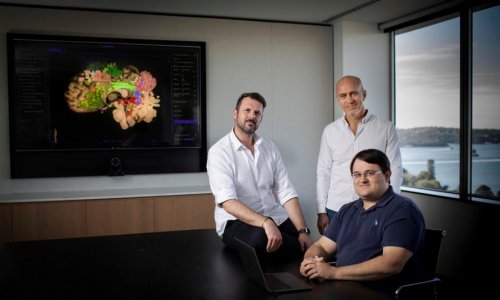

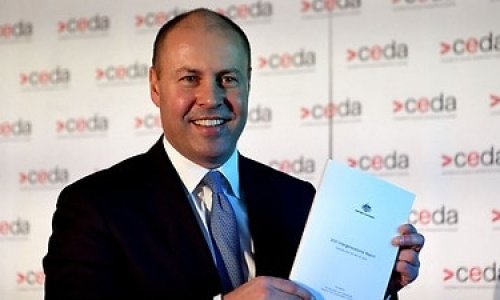

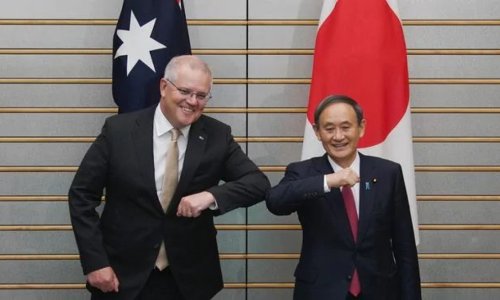

Bộ trưởng Công nghiệp và Khoa học Úc Đại Lợi, Ed Husic, mới đây đã công bố 10 hướng dẫn tự nguyện mới cho các hệ thống AI.

Ông cho biết, chính phủ đã tổ chức cuộc tham vấn kéo dài một tháng để xem xét liệu có nên bắt buộc áp dụng hay không những quy tắc trên cho những lĩnh vực có rủi ro cao trong tương lai.

Ông Husic nói, "Người dân Úc nhận thức được việc AI có thể mang lại những lợi ích to lớn, tuy nhiên họ cũng muốn bảo đảm an toàn nếu tình hình trở nên bất lợi".

Cũng theo vị viên chức này, chính phủ đã lắng nghe ý kiến tham vấn và cam kết sẽ có các biện pháp tăng cường bảo vệ.

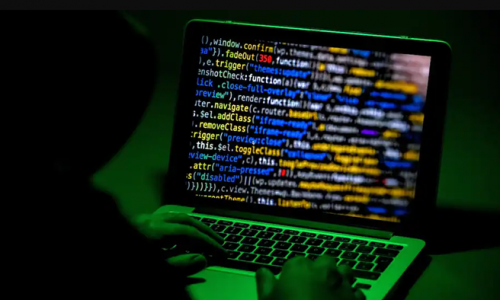

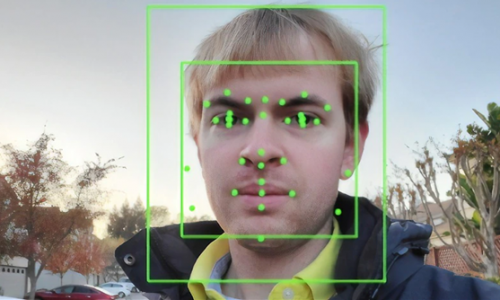

Báo cáo đi kèm với các hướng dẫn nói trên nêu bật tầm quan trọng của việc phải có sự giám sát của con người trong suốt vòng đời của một hệ thống AI. Việc này giúp giảm thiểu nguy cơ gây ra hậu quả không mong muốn và bảo đảm rằng các công ty sẽ minh bạch về vai trò của AI trong việc tạo ra nội dung.

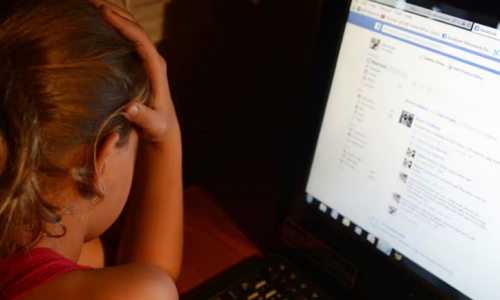

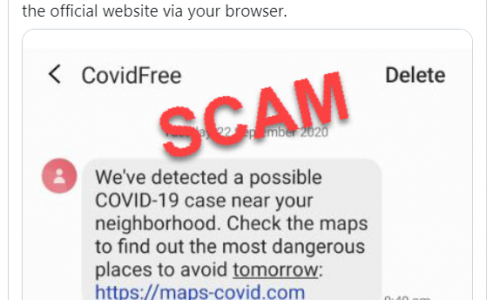

Thời gian qua, nhiều quốc gia trên khắp thế giới đã lên tiếng bày tỏ quan ngại về tình trạng thông tin sai lệch và tin giả tràn lan do các công cụ AI như ChatGPT và Gemini gây ra.

Liên minh Âu châu (EU) đã thông qua các đạo luật nghiêm ngặt về kiểm soát và quản lý AI, trong đó yêu cầu các hệ thống AI phải tuân thủ chặt chẽ hơn nghĩa vụ về tính minh bạch.

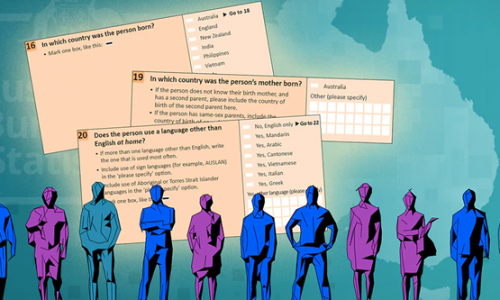

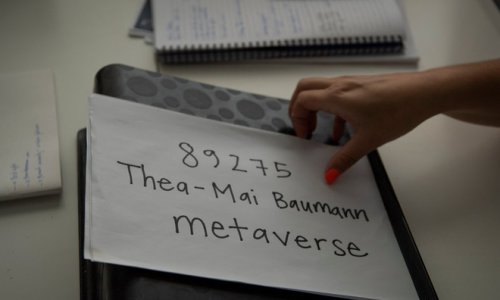

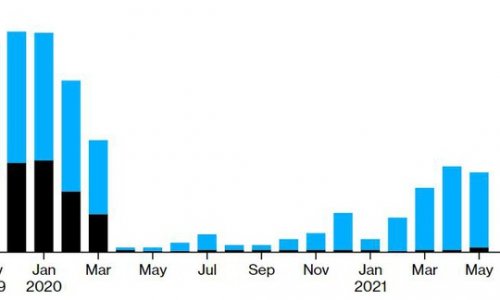

Mặc dù Úc chưa có luật cụ thể để quản lý AI, song đã đưa ra 8 nguyên tắc tự nguyện về việc sử dụng công nghệ này một cách có trách nhiệm từ năm 2019. Gần dây, một báo cáo của chính phủ đã chỉ ra rằng, các quy định hiện tại chưa đủ để xử lý các tình huống rủi ro cao.

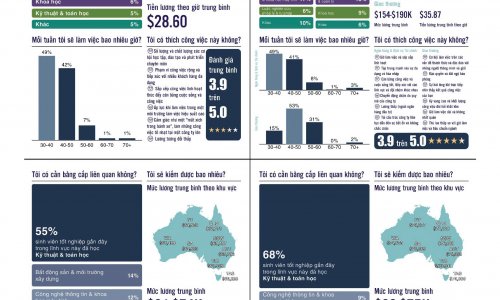

Ông Husic cũng cho biết, chỉ có khoảng 30% doanh nghiệp đang sử dụng AI một cách có trách nhiệm và bảo đảm các yêu cầu như an toàn, công bằng, trách nhiệm giải trình và minh bạch.